Higgsfield trifft Claude: Bilder und Videos generieren, ohne die App zu wechseln

Kurze Frage in die Runde: Wer von euch hat schon mal mitten im Schreiben gedacht „hier bräuchte ich jetzt eigentlich noch ein Bild dazu" – und dann genervt zwischen drei Tools hin- und hergesprungen? Genau das wird gerade deutlich entspannter. Higgsfield, einer der spannendsten Anbieter für KI-generierte Bilder und Videos, lässt sich seit kurzem direkt aus Claude heraus bedienen. Möglich macht das etwas, das sich MCP nennt – und genau darüber will ich heute mit euch sprechen. Ohne Tech-Geschwurbel. Was zur Hölle ist MCP? MCP steht für „Model Context Protocol". Klingt sperrig, ist im Kern aber etwas ganz Einfaches: eine Art universeller Stecker zwischen KI-Assistenten wie Claude und externen Diensten. Stellt euch das vor wie USB. Früher hatte jedes Gerät seinen eigenen Anschluss – heute steckt ihr alles in dieselbe Buchse, und es funktioniert. Genau das macht MCP für KI. Statt dass jeder Anbieter seine eigene Insellösung baut, gibt es einen gemeinsamen Standard. Anthropic hat das Protokoll erfunden, und immer mehr Dienste springen auf. Higgsfield ist jetzt einer davon. Und was bringt mir das konkret? Ihr arbeitet ohnehin schon mit Claude – etwa um Texte zu schreiben, zu recherchieren oder Konzepte zu entwickeln. Bisher war es so: Wenn ihr ein Bild oder Video brauchtet, musstet ihr in die Higgsfield-App wechseln, dort einen Prompt eingeben, das Ergebnis abwarten, herunterladen, wieder zurück zu Claude. Jetzt sagt ihr einfach mitten im Chat: „Mach mir dazu ein Video, in dem ein Roboter durch eine Wüste läuft" – und Claude reicht das direkt an Higgsfield weiter. Das Ergebnis erscheint im selben Chatfenster. Punkt. Das spart nicht nur Klicks. Es spart vor allem Kontextwechsel im Kopf. Und das ist der eigentliche Gamechanger. Wer kreativ arbeitet, kennt das Problem: Jeder Toolwechsel reißt euch aus dem Flow. Mit MCP bleibt der Flow erhalten. Was kann Higgsfield überhaupt? Falls ihr den Anbieter noch nicht kennt – Higgsfield ist auf zwei Dinge spezialisiert, in denen es ziemlich gut ist:

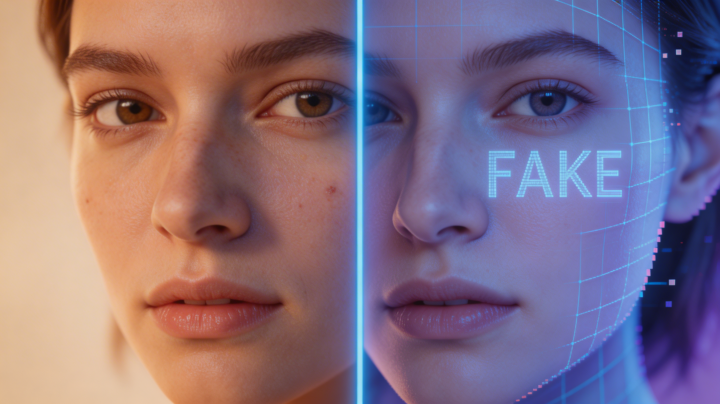

Wenn Selfies lügen lernen

Ich habe gestern Selfies mit Von der Leyen, Musk, Tim Cook und Jennifer Lawrence gemacht. Ohne mein Büro zu verlassen. 📸 Und genau da fängt das Problem an. ChatGPT Images 2.0 und Nano Banana Pro liefern mittlerweile Bilder, bei denen meine eigene Mutter angerufen hat, wann ich denn in Brüssel war. Hautporen, Lichtstimmung, das schiefe Selfie-Lächeln – alles sitzt. Keine sechs Finger mehr. Keine Wachsfiguren-Optik. Einfach echt. Was bedeutet das für uns? Eine ganze Beweis-Währung wird gerade entwertet. Jahrelang galt: Pics or it didn't happen. Ein Foto war ein stabiles Stück Wirklichkeit. Im Urlaub, im Job, vor Gericht, in der Bewerbung. Diese Selbstverständlichkeit ist gerade Geschichte. Und es geht in beide Richtungen: → Falsche Bilder wirken echt. → Echte Bilder können als „bestimmt KI" abgetan werden. Juristen nennen das die Liar's Dividend – die Dividende des Lügners. Wer ohnehin lügt, profitiert am meisten davon, dass Wahrheit angreifbar geworden ist. Was heißt das konkret für uns als Community? Spart euch die „So erkennt ihr KI-Bilder in 5 Schritten"-Listen. Die funktionieren nicht mehr. Was funktioniert, ist eine neue Standardannahme: ❌ Alt: Ein Bild ist echt, solange nichts dagegen spricht. ✅ Neu: Ein Bild ist ein Vorschlag, solange seine Herkunft nicht überprüft ist. Klingt anstrengend. Ist es auch. Aber genau diese Hygiene macht den Unterschied zwischen „Ich nutze KI" und „KI nutzt mich". Wer KI als Superkraft begreift, muss auch die Schattenseite verstehen. Sonst wird man Teil des Problems, statt Teil der Lösung. Den ausführlichen Kommentar dazu findet ihr in meinem aktuellen LinkedIn-Beitrag – mit allen Beispiel-Selfies, die ich mit ChatGPT Images 2.0 erstellt habe. Schaut euch das an, ihr werdet es nicht glauben. 💬 Eure Frage an euch selbst: Wann habt ihr zuletzt ein Bild im Netz gesehen und euch gefragt: Ist das wirklich echt? Schreibt's in die Kommentare. Lasst uns diskutieren – und voneinander lernen. 🦾 Eure Superkraft KI Soll ich noch eine kürzere Version (für ein schnelles „Daily Drop" in der Community) oder eine ausführlichere Variante mit konkretem Diskussions-Workshop daraus bauen?

Bild-KI: OpenAI greift Google an – und holt auf

Gestern hat OpenAI ChatGPT Images 2.0 rausgehauen. Und zum ersten Mal seit Monaten wird's im Bild-KI-Rennen wieder richtig interessant. Kurz zur Einordnung: Seit November führt Googles Nano Banana Pro den Markt an. Das Ding ist ein Biest – 4K-Auflösung, 14 Referenzbilder gleichzeitig, bis zu fünf Personen konsistent über mehrere Bilder hinweg, volle Kontrolle über Licht, Kamera und Tiefenschärfe. Studio-Qualität. Was OpenAI jetzt kontert: 🧠 „Thinking"-Modus – das Modell denkt vor dem Zeichnen. Es recherchiert im Web, prüft sich selbst und baut Layouts durch, bevor es rendert. 🎞 Bis zu 8 zusammenhängende Bilder aus einem Prompt – mit gleichen Figuren. Heißt: Storyboards, Comics, Kampagnen-Serien in einem Rutsch, statt mühsam Bild für Bild zu stitchen. 🌍 Sauberes Text-Rendering auch in Japanisch, Koreanisch, Hindi, Bengali. Genau da, wo Google bisher die Messlatte gesetzt hat. 📐 Bis zu 2K-Auflösung, flexible Formate von 3:1 bis 1:3. Wer liegt jetzt vorn? Ehrlich: Google noch. Nano Banana Pro bleibt bei Auflösung (4K), Referenzbildern (14 vs. OpenAIs geringere Zahl) und Feinkontrolle klar überlegen. OpenAI hat aber bei Text, Multilingualität und dem Thinking-Ansatz ordentlich aufgeholt – und in manchen Workflows (Sequenzen, Storyboards) könnte Images 2.0 sogar besser sein. Was bedeutet das für Dich? 👉 Keine Glaubensfrage. Werkzeugfrage. Für Infografiken, Produktmockups und alles, wo Du maximale Kontrolle brauchst: Nano Banana Pro. Für Storytelling, Comic-Serien, mehrteilige Kampagnen mit konsistenten Figuren: unbedingt Images 2.0 testen. Ich werde in den nächsten Tagen beide Modelle mit denselben Prompts durchjagen und die Ergebnisse hier teilen. Wer mitmachen will: Stellt Eure Testprompts gern in die Kommentare, dann nehm' ich sie mit rein. Was mich wirklich freut: Noch vor einem Jahr haben Bildmodelle an lesbarer Schrift gescheitert. Heute streiten zwei Tech-Giganten darum, wer Magazine layouten kann. Der Wettbewerb tut diesem Markt extrem gut. 🙌

Ich hab die Zeit angehalten – mit KI ⏸️

Klingt übertrieben? Schaut euch das Video an. Das ist kein After Effects. Das ist Seedance 2.0 – ein KI-Videomodell von ByteDance (ja, die TikTok-Leute). Und ehrlich gesagt hat mich das kurz sprachlos gemacht. Was Seedance 2.0 kann: Du gibst dem Modell Text, Bilder, Videos UND Audio – bis zu 12 Dateien gleichzeitig. Raus kommt ein fertiges Video mit synchronem Sound, Kamerabewegungen wie vom Regisseur und Figuren, die über mehrere Schnitte konsistent bleiben. Du kannst sogar ein Referenzvideo hochladen und sagen: "Mach genau diese Kamerabewegung, aber mit meinem Charakter." Das Modell versteht es einfach. Kein anderes Modell kann das aktuell so. Wo steht Seedance im Vergleich? - Sora 2 (OpenAI) → realistischste Physik - Veo 3.1 (Google) → poliertester Output, broadcast-tauglich - Kling 3.0 (Kuaishou, China) → günstig, schnell, native 4K - Seedance 2.0 → meiste kreative Kontrolle, Platz 1 in unabhängigen Benchmarks Was das gesellschaftlich bedeutet: Tage nach dem Launch gingen virale Clips um die Welt – Brad Pitt gegen Tom Cruise, Friends als Otter. Disney schickte eine Unterlassungserklärung. US-Senatoren forderten die Abschaltung. In China? Begeisterung. Zwei Welten, zwei Reaktionen. Und die unbequeme Frage: Wenn eine KI in Sekunden ein Video erzeugt, das aussieht wie Hollywood – was passiert mit Kameraleuten, VFX-Artists, Cuttern? Deadpool-Co-Autor Rhett Reese schrieb: Für uns ist es wahrscheinlich vorbei. Dazu kommt die Deepfake-Frage. Seedance beherrscht Lippensync in über 8 Sprachen auf Phonem-Ebene. Beeindruckend und gefährlich gleichzeitig. ByteDance hat Wasserzeichen und Sperren eingebaut – aber wer glaubt, dass das reicht, hat das Internet nicht verstanden. Meine Einschätzung: Die Frage ist nicht mehr, ob KI-Video den Mainstream erreicht. Die Frage ist, ob wir schnell genug Spielregeln dafür aufstellen. Was sagt ihr – mehr Faszination oder mehr Sorge? Schreibt's in die Kommentare 👇

🔍 Deepfakes: Was du jetzt darüber wissen solltest

Deepfakes sind gerade überall in den Nachrichten – wegen des Falls Collien Fernandes, wegen Demos in Berlin und Hamburg, wegen eines Gesetzentwurfs der Bundesregierung. Aber mal ehrlich: Weißt du eigentlich, was genau hinter dem Begriff steckt, wie die Technik funktioniert und warum das Thema gerade jetzt so explodiert? Hier die wichtigsten Hintergründe – kompakt, verständlich und ohne Juristendeutsch. Woher kommt der Begriff? „Deepfake" ist ein Kofferwort aus Deep Learning (eine Methode der Künstlichen Intelligenz) und Fake (Fälschung). Geprägt hat den Begriff Ende 2017 ein anonymer Reddit-Nutzer mit dem Pseudonym „deepfakes". Der hatte mithilfe neuronaler Netze Gesichter von Schauspielerinnen in Pornovideos montiert – und seinen Code einfach öffentlich ins Netz gestellt. Innerhalb weniger Wochen hatte das zugehörige Forum über 90.000 Abonnenten. Reddit hat es dann gesperrt, aber der Geist war aus der Flasche. Der Begriff hat sich seitdem stark geweitet. 2017 meinte man damit nur ganz bestimmte KI-generierte Gesichtertausch-Videos. Heute steht „Deepfake" für praktisch jedes KI-erzeugte oder KI-manipulierte Medium – ob Bild, Video oder Audio. Wie funktionieren Deepfakes technisch? Die Grundlage legte 2014 der Informatiker Ian Goodfellow mit den sogenannten Generative Adversarial Networks (GANs). Das Prinzip ist genial einfach: Zwei neuronale Netze treten gegeneinander an. Das eine erzeugt eine Fälschung, das andere versucht sie zu entlarven. Durch dieses ständige Katz-und-Maus-Spiel werden die Ergebnisse immer besser – bis die Fälschung vom Original kaum noch zu unterscheiden ist. Beim klassischen Face Swap lernt ein sogenannter Autoencoder, wie ein bestimmtes Gesicht aussieht – aus verschiedenen Winkeln, bei verschiedener Beleuchtung, mit unterschiedlicher Mimik. Hat das Netz genug gelernt, kann es dieses Gesicht selbstständig erzeugen und in ein fremdes Video einsetzen. Der Mund bewegt sich synchron, die Mimik passt – täuschend echt. Für Audio-Deepfakes (Voice Cloning) wird die Stimme einer Person analysiert – Tonhöhe, Sprechrhythmus, Betonung – und dann synthetisch nachgebaut. Das Ergebnis: Ein KI-generierter Klon, der klingt wie das Original.

1-24 of 24

skool.com/superkraft-ki

KI verstehen. KI nutzen. Superkräfte aktivieren.

Powered by