Activity

Mon

Wed

Fri

Sun

May

Jun

Jul

Aug

Sep

Oct

Nov

Dec

Jan

Feb

Mar

Apr

What is this?

Less

More

Memberships

Experten Mastermind

241 members • Free

KI Creator Hub

393 members • Free

AI Content Creation Community

4.5k members • Free

Design mit Struktur & KI

434 members • Free

2 contributions to Superkraft KI

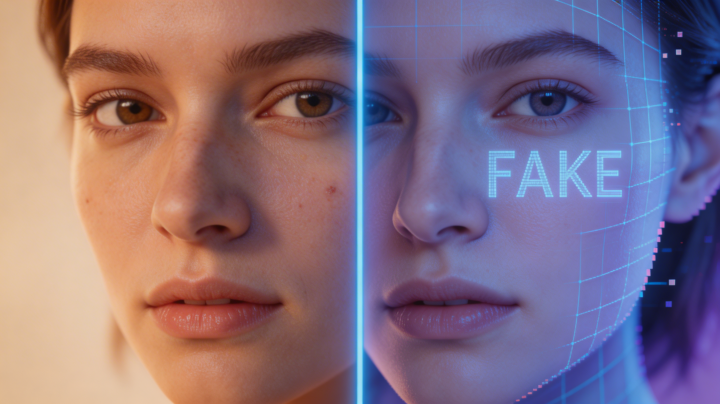

🔍 Deepfakes: Was du jetzt darüber wissen solltest

Deepfakes sind gerade überall in den Nachrichten – wegen des Falls Collien Fernandes, wegen Demos in Berlin und Hamburg, wegen eines Gesetzentwurfs der Bundesregierung. Aber mal ehrlich: Weißt du eigentlich, was genau hinter dem Begriff steckt, wie die Technik funktioniert und warum das Thema gerade jetzt so explodiert? Hier die wichtigsten Hintergründe – kompakt, verständlich und ohne Juristendeutsch. Woher kommt der Begriff? „Deepfake" ist ein Kofferwort aus Deep Learning (eine Methode der Künstlichen Intelligenz) und Fake (Fälschung). Geprägt hat den Begriff Ende 2017 ein anonymer Reddit-Nutzer mit dem Pseudonym „deepfakes". Der hatte mithilfe neuronaler Netze Gesichter von Schauspielerinnen in Pornovideos montiert – und seinen Code einfach öffentlich ins Netz gestellt. Innerhalb weniger Wochen hatte das zugehörige Forum über 90.000 Abonnenten. Reddit hat es dann gesperrt, aber der Geist war aus der Flasche. Der Begriff hat sich seitdem stark geweitet. 2017 meinte man damit nur ganz bestimmte KI-generierte Gesichtertausch-Videos. Heute steht „Deepfake" für praktisch jedes KI-erzeugte oder KI-manipulierte Medium – ob Bild, Video oder Audio. Wie funktionieren Deepfakes technisch? Die Grundlage legte 2014 der Informatiker Ian Goodfellow mit den sogenannten Generative Adversarial Networks (GANs). Das Prinzip ist genial einfach: Zwei neuronale Netze treten gegeneinander an. Das eine erzeugt eine Fälschung, das andere versucht sie zu entlarven. Durch dieses ständige Katz-und-Maus-Spiel werden die Ergebnisse immer besser – bis die Fälschung vom Original kaum noch zu unterscheiden ist. Beim klassischen Face Swap lernt ein sogenannter Autoencoder, wie ein bestimmtes Gesicht aussieht – aus verschiedenen Winkeln, bei verschiedener Beleuchtung, mit unterschiedlicher Mimik. Hat das Netz genug gelernt, kann es dieses Gesicht selbstständig erzeugen und in ein fremdes Video einsetzen. Der Mund bewegt sich synchron, die Mimik passt – täuschend echt. Für Audio-Deepfakes (Voice Cloning) wird die Stimme einer Person analysiert – Tonhöhe, Sprechrhythmus, Betonung – und dann synthetisch nachgebaut. Das Ergebnis: Ein KI-generierter Klon, der klingt wie das Original.

🔐 Kurzer Test: Frag mal ChatGPT nach einem Passwort.

🔐 Kurzer Test: Frag mal ChatGPT nach einem Passwort. Du bekommst sowas: G7$kL9#mQ2&xP4!w Sieht stark aus. Jeder Passwort-Checker jubelt. Und trotzdem ist es gefährlich schwach. Warum? KI-Sprachmodelle funktionieren, indem sie immer das Wahrscheinlichste vorhersagen. Das macht sie gut beim Schreiben und Erklären. Bei Passwörtern ist genau das das Problem – denn sichere Passwörter brauchen echte Zufälligkeit. Die kann kein Chatbot liefern. Eine aktuelle Studie hat Claude 50 Mal nach einem Passwort gefragt. Ergebnis: Dasselbe Passwort kam 18 Mal. Das sind 36 Prozent – bei etwas, das "zufällig" sein soll. Was stattdessen funktioniert: → Passwortmanager wie Bitwarden (kostenlos) oder 1Password nutzen – die generieren echte Zufallspasswörter → Wo möglich: Passkeys aktivieren – kein Passwort, kein Problem → Immer: Zwei-Faktor-Authentifizierung einschalten KI ist ein mächtiges Werkzeug. Aber für Passwörter gibt es bessere. 💬 Habt ihr ChatGPT schon mal nach einem Passwort gefragt? Was kam raus?

1-2 of 2

Active 1h ago

Joined Apr 8, 2026

Hamburg

Powered by