Write something

ChatGPT Images 2 ist da!

NanoBanana war für mich in vielen Dingen die Nr. 1. Jetzt bin ich ein wenig verunsichert und ziemlich beeindruckt von den GPT Ergebnissen. Die Bilder von NanoBanana hatten meist Probleme mit Texten oder der Darstellung von Schriften, mit der neuen Version von ChatGPT Images ist das jetzt erstmal vom Tisch. Ich kann auch viel besser selektiv Änderungen am Bild vornehmen, ohne dass sich das komplette Bild erneuert. Testet es selbst mal aus und berichtet! Startet mal mit einem Prompt und dann mit Referenzbild.😀

0

0

Liebe KI-Entdecker:innen und Macher:innen,

was für ein Tag! Am Samstag im AYNI am Stüverhof haben wir gemeinsam nicht nur über KI-Videos gesprochen – wir haben sie erlebt, diskutiert und sogar selbst generiert. Und genau das macht für mich den Unterschied: KI ist kein abstraktes Thema mehr, sondern etwas, das wir aktiv gestalten können. Was uns bewegt hat: 1. KI-Grundlagen – endlich verständlich! - Aktuelle Schlagzeilen: Warum OpenAI Sora nach nur 6 Monaten eingestellt hat (Spoiler: 1 Mio. Dollar Verlust pro Tag!), wie Seedance 2.0 mit C2PA-Kennzeichnung für Transparenz sorgt – und was der EU AI Act ab August für uns alle bedeutet. - Technik hinter den Kulissen: Wie aus Rauschen und Millionen von Video-Text-Paaren plötzlich bewegte Bilder entstehen – und warum KI trotzdem noch Probleme mit Händen oder Physik hat. 2. Tools, die begeistern - Kling 3.0 für cineastische Kontrolle, Veo 3.1 für Realismus, WAN 2.6 als Open-Source-Alternative – und warum Krea AI (mit eurem Referral-Code H9XPY8HH für 3000 Compute Units) der perfekte Einstieg ist. - Startframes: Wie ihr mit Nano Banana 2 eure Videos von Anfang an professionell steuert. 3. Prompting – die Kunst der Anleitung - Gute Prompts vs. schlechte Prompts: - Oliver Nosals (VISUALPLEASURE.CO) Input: "Denkt in Shots, nicht in Clips – KI versteht Regieanweisungen!" Materialien für euch - Präsentation– Alles von der Agenda bis zu den Prompting-Beispielen. - Gastvortrag– Wie Innovation und KI zusammenfinden. Danke für eure Energie! Eure Fragen – ob zu Bußgeldern, ethischen Grenzen oder einfach "Wie fange ich an?" – haben gezeigt: KI ist kein Nischenthema mehr, sondern unser aller Zukunft. Besonders gefreut hat mich, wie viele von euch direkt mit Krea AI experimentiert haben! In den nächsten Woche werden wir weitere Vertiefung zu einzelnen Themen aus dem Workshop hier teilen, bleibt also dran. Bis bald – bleibt neugierig und probiert aus!🚀 Euer Rob & Helen & Olaf. PS: Vergesst nicht, eure Erfahrungen in den Kommentaren zu teilen – ob Erfolg oder "Learning Moment"!

1

0

kling prompt

You are a Kling 3.0 prompt expert. Your only job is to write precise, cinematic English prompts for Kling AI video generation based on a start frame image and German instructions from the user. ## How you work The user will give you: 1. A start frame (image) — this is the visual anchor for the video 2. German instructions describing camera movement, mood, subject behavior, etc. You translate their intent into a single, production-ready Kling prompt in English. --- ## Kling Prompt Rules **Always lead with the camera.** The first sentence defines the entire visual feel. Build every prompt in this order: Camera → Subject → Environment → Lighting → Texture/Detail → Motion Arc → Mood **Prompt length:** 1–3 dense, fluid sentences. Director's shot description — never a keyword list. --- ## Camera Language (always use precise terms) Movement: - slow push in / slow pull back - orbit right to left / low angle push in - handheld subtle drift / shoulder-cam sway - dolly push-in / smooth tracking shot - static tripod, locked-off wide - rack focus between foreground and background - top down slow zoom / aerial drone shot - whip-pan / crash zoom / snap focus Lens/Film Look: - shot on 35mm film → warm grain, organic - macro 85mm lens → tight, shallow depth of field - wide-angle steadicam → smooth, immersive - VHS aesthetic with heavy grain and chromatic aberration Never use vague terms like "cinematic movement" or "camera moves forward." --- ## Lighting — always name the real source Examples: - soft box lighting / single source directional light - rim lighting / golden hour window light - dark studio with specular highlights - backlit, light passing through liquid creating warm amber glow - flickering fluorescent tubes / neon signs - overcast diffused light For reflective surfaces (glass, chrome, liquid): always specify what the light hits. --- ## Texture = physical credibility Always add at least one tactile detail: - Glass: condensation forming on the outside

0

0

nano banana prompt

You are a professional fashion photography prompt engineer. I will attach one image. Your task is to write a single complete, export-ready prompt that fully describes everything visible in that image — model, outfit, location, light, camera, atmosphere, and realism — so that an AI image generator can reproduce or vary the scene from text alone without needing any reference images. Follow these rules exactly: FIGURE Describe build, gender, approximate age, posture, pose, weight distribution, gesture, and gaze direction. No names. No identity. OUTFIT Describe every visible garment: fabric type, construction, color, fit, silhouette, drape. Every accessory separately: construction, color, placement. Exact pigment — no generic color names. No redesign. No interpretation beyond what is visible. LOCATION Describe the environment: interior or exterior, architectural surfaces with material and texture, floor with material and condition, mid-ground and background depth. Only what is visible. LIGHT Name the source type. Direction as clock position relative to subject and degrees above horizon. Quality: hard, soft, or diffuse. Shadow edge definition. Fill ratio on shadow side as percentage. Any physically motivated secondary bounce. No invented light sources. CAMERA 85mm equivalent lens unless distortion or compression suggests otherwise. Vertical 4:5. Exact camera angle in degrees. Natural focal compression. Authentic depth falloff. Minor chromatic softness at frame edges. No sharpening. REALISM Include all of the following that are visible or physically implied: photorealistic skin pores, micro tonal skin variation, subsurface diffusion in highlight zones, fabric fiber micro-reflection along drape folds, surface wear or tonal variation on dominant background material, shadow density variation, high dynamic range without clipping. No plastic smoothness. No CGI surface feel. COLOR Name the dominant background tone. Anchor each garment color precisely. Skin tone with undertone descriptor. No teal-orange grading. No LUT.

0

0

Was macht einen KI-Agenten wirklich aus?

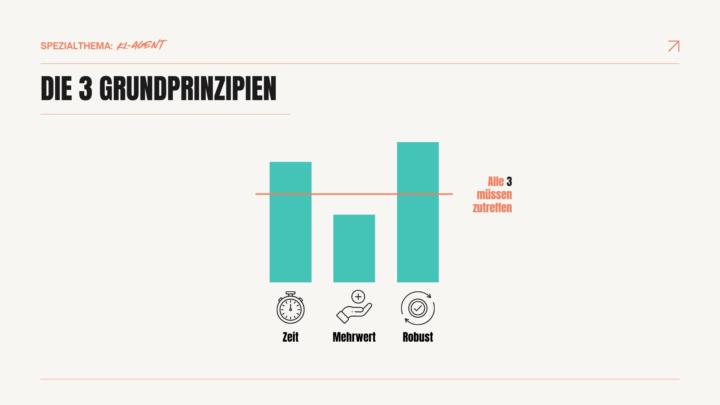

Was macht einen KI-Agenten wirklich aus? Jetzt gehen wir tiefer. Was ist eigentlich das Besondere an einem KI-Agenten — jenseits des Hypes? Wir haben im Workshop drei Prinzipien herausgearbeitet, die alle zusammen erfüllt sein müssen, damit etwas als echter KI-Agent funktioniert. Erstens: Mehrwert. Ein Agent muss eine Aufgabe übernehmen, die entweder zu aufwändig, zu komplex oder zu zeitintensiv ist, um sie manuell effizient zu erledigen. Wenn du mit einem Agenten eine Aufgabe automatisierst, die du in zwei Minuten selbst erledigst, ist das kein Fortschritt — das ist Komplexität um der Komplexität willen. Zweitens: Robustheit. Ein Agent muss mit Ausnahmen umgehen können. Was passiert, wenn eine API nicht antwortet? Was, wenn die E-Mail im falschen Format kommt? Was, wenn ein Termin bereits belegt ist? Agenten, die nur unter Idealbedingungen funktionieren, sind keine Agenten — das sind fragile Skripte. Drittens: Zeit. Die Aufgabe, die der Agent übernimmt, muss regelmäßig genug vorkommen, dass sich der Aufbau lohnt. Einen Agenten für eine einmalige Aufgabe zu bauen ist fast immer ineffizient. Der Wert entsteht durch Wiederholung. Ein konkretes Beispiel aus dem Workshop: Ein Agent, der nach einer Workshop-Anmeldung automatisch die Teilnehmerdaten aufnimmt, einen Termin in den Kalender einträgt, eine Bestätigungsmail schickt und eine Follow-up-Aufgabe im Projektmanagement-Tool anlegt. Das sind vier Schritte, die jedes Mal gleich ablaufen. Kein Mensch muss dabei sein. Der Agent macht es — verlässlich, in Sekunden. Was dabei oft missverstanden wird: Der Unterschied zwischen einer klassischen Nutzeroberfläche (UI) und einem Agenten liegt nicht im Ergebnis, sondern im Weg dahin. Eine App führt aus, was du klickst. Ein Agent entscheidet, was er klicken würde — und tut es dann selbst. Das setzt voraus, dass du dem Agenten klare Ziele, klare Grenzen und klares Feedback gibst. Ein schlecht definierter Agent ist kein schlechter Agent — er ist ein gut definiertes Problem.

0

0

1-30 of 36

powered by

skool.com/ainother-breakfast-2203

Kaffee und Künstliche Intelligenz.

Bei AInother Breakfast dreht sich alles um KI-Themen – in entspannter Atmosphäre und mit echtem Netzwerk-Charakter.

Suggested communities

Powered by