Activity

Mon

Wed

Fri

Sun

May

Jun

Jul

Aug

Sep

Oct

Nov

Dec

Jan

Feb

Mar

Apr

What is this?

Less

More

Owned by Jelord

AI x 自動化 Skool 是專為使用者打造的學習與交流社群 ✔️結合生成式 AI 與工作流程自動化的實戰經驗 ✔️幫助個人與企業輕鬆掌握最新技術 ✔️實現效率提升與創新突破。

Memberships

Super Rich:新時代的富足

10 members • Free

AI x 自動化學院|AI x Automation

35 members • $49/m

Automate What Academy PRO

38 members • $89/m

The Build Room

2.4k members • $97/month

AI Automation School

368 members • $30/m

AI 10倍速工作流 | Winston

170 members • $20/m

AI Video Bootcamp

18.1k members • $9/month

Unity 開發者共學基地

102 members • Free

OMG | One Man Group

523 members • Free

20 contributions to AI 自動化中心

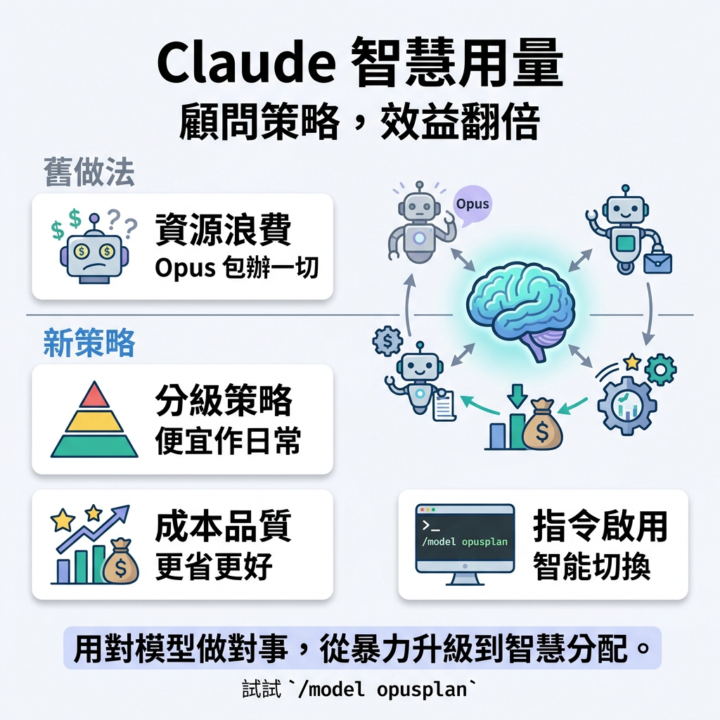

🤔 你也覺得 Claude Code 最近變笨了嗎?

AMD 的 AI 總監拿了 7,000 個 session 的數據分析,結論是 thinking depth 暴跌 67%,讀 code 的次數少了 3 倍,直接改整個檔案的頻率翻倍 但 Anthropic 的回應不是道歉 而是推了一個叫 Advisor Strategy 的使用教學 教你怎麼選對模型,省錢同時不犧牲品質 以下拆解這個策略是什麼、怎麼用、以及到底值不值得信 --- 1️⃣ 🧩 什麼是 Advisor Strategy? 說白了就是一句話:不是每件事都要用最貴的模型 Claude 有三個等級,價差很大: 🔴 Opus(最強)— input $5 / output $25(每百萬 token) 🟡 Sonnet(中間)— input $3 / output $15 🟢 Haiku(最快最便宜)— input $1 / output $5 以前你用 Claude Code,預設就是 Opus 或 Sonnet 做所有事 寫 code、debug、查資料、讀文件,全部同一個模型 Advisor Strategy 改變了這個邏輯: 讓便宜的 Sonnet 或 Haiku 當「執行者」,負責處理日常任務 只有遇到真的搞不定的問題,才去問 Opus 這個「顧問」 就好像你請了個助理處理日常的事,碰到棘手的法律或財務問題才叫外部顧問進來 重點是:助理自己判斷什麼時候需要升級,不用你每次都指定 Anthropic 的人自己形容叫「phone a friend」— Sonnet 遇到搞不定的才打電話問 Opus --- 2️⃣ 📊 數據說話:省多少?品質怎樣? Anthropic 官方測試結果: 📈 Sonnet + Opus 當顧問 程式碼能力(SWE-bench)比純 Sonnet 高 2.7% 每個任務的成本降了 11.9% 📈 Haiku + Opus 當顧問 搜尋能力(BrowseComp)從 19.7% 翻到 41.2%,超過翻倍 成本比用純 Sonnet 低 85% 換句話說: ❌ 舊做法:全部用 Opus 做,品質最好但最貴,session 燒得快 ✅ 新做法:Sonnet 做大部分事,關鍵時刻 Opus 出手指導 結果品質接近甚至更好,因為 Opus 只在需要的時候介入 不是什麼都做,而是在關鍵決策點給方向 你讓 Opus 幫你查資料 說難聽一點就是請律師幫你影印文件 資源要用在刀刃上 --- 3️⃣ ⚡ Claude Code 裡怎麼用? 如果你用的是 Claude Code(不是 API 開發者),已經有現成的方法 打 /model opusplan 就這樣,一行指令 設好之後會自動切換: 🧠 Plan mode — 用 Opus 想清楚方向、架構、策略 ⚡ Execution mode — 切回 Sonnet 去寫 code、改 bug、跑任務 等於 Opus 出主意,Sonnet 去幹活 你在 status bar 上可以看到現在用的是哪個模型 進 plan mode 會顯示 Opus,退出就自動切回 Sonnet 實測下來 session 用量明顯減少 因為 Opus 只在 plan mode 被叫出來 不會在 execution 時燒你的額度 💡 進階搭配: plan 完了打 /compact 壓縮上下文再執行,token 省更多 避開尖峰時段(美東早上 8 點到下午 2 點)額度消耗會更慢 --- 4️⃣ 🤔 但說真的,這到底是誰贏? 我有一個疑問想跟大家討論 Anthropic 教你「不要一直用 Opus」 到底是真心幫你省錢 還是因為 Opus 算力太貴,他們不想你用那麼多? 想想看: 你付的月費不會少一分 但他們的 GPU 負擔可以輕很多 而且如果模型自己判斷「這個任務不需要 Opus」但其實需要呢? 品質偷偷變差,你未必察覺得到 IDC 預測到 2028 年,70% 的 AI 企業會採用多模型架構 所以「用對的模型做對的事」這個大方向是確定的 但 Anthropic 的動機到底是什麼? 這個就留給你自己判斷了 --- 🧠 結論:從「暴力升級」到「智慧分配」 舊思維:所有事情用最強的 Opus,品質第一,錢不是問題 新思維:讓對的模型做對的事,在關鍵時刻才用最強的 不管 Anthropic 的動機是什麼,這個思路本身就是對的 你不需要每個問題都找最貴的專家 你需要的是一個會判斷什麼時候該找專家的系統 花 5 分鐘打 /model opusplan 試一下,讓結果說話

不用資料庫,不用寫程式,用 AI 自動整理你的所有知識

Karpathy 一篇帖引爆 AI 圈:不用資料庫,不用寫程式,用 AI 自動整理你的所有知識 Andrej Karpathy — OpenAI 創始成員、前 Tesla AI 總監 — 四天前在 X 上發了一篇帖。 1500 萬 views,9 萬人收藏。 他講的東西很簡單:你不需要複雜的 AI 工具來管理知識。一個免費的筆記軟體 + 一個 AI 助手,就能幫你把散落的資料變成一個「會自己長大的百科全書」。 這篇幫你用白話拆解他的方法,不管你有沒有技術背景,看完都能理解。 --- 1️⃣ 為什麼這件事值得關注? 你有沒有遇過這種情況: 上週用 ChatGPT 查了一個問題,得到了很好的答案。這週又需要用到,結果對話紀錄找不到了,只好重新問一次。 或者你有一堆 PDF、筆記、網頁收藏,散落在不同的 app 裡面,想找某個東西要翻半天。 這就是 Karpathy 想解決的問題 — AI 對話是「用完即丟」的,你的知識沒有被累積下來。 他的解法是:讓 AI 不只是回答你的問題,而是幫你把所有資料整理成一個有結構的知識庫。問過的東西不會消失,而且越問越聰明。 --- 2️⃣ 他的方法到底是什麼? 架構非常簡單,就是兩個資料夾: 📁 第一個叫「raw」— 你把所有原始資料丟進去。文章、PDF、網頁、會議紀錄,什麼都行。 📁 第二個叫「wiki」— AI 讀完你的資料後,自動整理成一篇一篇有結構的筆記。每篇筆記之間還會互相連結,就像維基百科一樣。 再加一份「目錄」(index),記錄所有筆記的清單。 你之後問任何問題,AI 順著目錄和連結找到答案 — 不是上網亂搜,是從你自己的資料裡找。 工具就兩個: 📌 Obsidian — 免費的筆記軟體,讓你用肉眼看到整個知識網路的關係圖 📌 Claude Code — AI 助手,負責讀資料、整理、建連結 --- 3️⃣ 跟以前的做法有什麼不同? 以前如果你想讓 AI 處理大量資料,標準做法叫 RAG。 白話講就是:把你的文件切成碎片,用數學方式存進一個特殊的資料庫。你問問題的時候,AI 去資料庫找「看起來最像」的碎片回來拼答案。 聽起來很厲害,但問題有兩個: 📌 門檻高 — 要架資料庫、寫程式、處理一堆技術問題 📌 碎片沒關係 — AI 找到 A 不知道 B 也相關,你要自己在腦中拼起來 Karpathy 的做法相反 — 不切碎,讓 AI 讀完整份資料,然後自己整理成有結構的筆記。 筆記之間有目錄、有連結、有摘要 — 就像一本 AI 自動生成的百科全書。 有人實測把 383 個散落文件丟進去,之後查東西的成本直接降了 95%。 最關鍵的是:你不用懂什麼是向量、什麼是 embedding、什麼是 chunking。你只要會把文件丟進資料夾就行。 --- 4️⃣ 適合誰?什麼時候用? 這個方法特別適合: 📌 研究生 — 整理論文和文獻 📌 自由工作者 — 管理客戶資料和專案筆記 📌 創業者 — 追蹤決策、整理市場研究 📌 內容創作者 — 整理靈感、素材、參考資料 📌 任何有「資料散落在各處」痛點的人 Karpathy 自己目前是 100 篇文章、40 萬字,運作得很順暢。個人用或小團隊完全夠用。 如果你的資料量到了上萬甚至百萬份文件(通常是大企業級別),那才需要考慮傳統的資料庫方案。一般人根本用不到那個級別。 --- 5️⃣ 怎麼開始?三步 1. 下載 Obsidian(完全免費)→ 建一個資料夾當你的知識庫 2. 裝 Web Clipper 瀏覽器套件 → 以後看到有用的網頁一鍵存進去 3. 打開 Claude Code → 跟它說「幫我把這些資料整理成 wiki」 就這樣。AI 會自動幫你分類、建目錄、加連結。之後你問它任何問題,它都能從你的資料裡找到答案。 以前整理知識是苦力活。現在你只負責丟資料進去,AI 負責整理。 --- 💬 你的資料現在散在哪裡?PDF?筆記 app?瀏覽器書籤?有沒有想過全部整理起來? 👇 留言分享你的知識管理痛點 加入VIP群眾看進階教學

Claude Code 抓不到網站資料?Firecrawl 輕鬆幫你解決,讓 AI 幫你爬網站做報告|AI 爬蟲入門教學

Claude Code 有一個很大的弱點,它爬不了大部分的知名網站 你叫它查競爭對手的定價頁面,403 被擋 你叫它爬房屋的樓盤資料,出現JavaScript 渲染,拿到一片空白 你叫它批量研究 50 家公司的背景,它跟你說「無法訪問」 裝一個工具就解決了:Firecrawl 一行指令安裝,之後你只要用自然語言跟 Claude 講話就好 四個我測過最實用的場景: 1. 爬 JS 動態渲染的網站 2. 一鍵競品分析 — 同時爬三家對手,自動出報告 3. 行業及客戶情報研究 4. SEO 審計 — 全站掃描 + 改善建議 另外為大家送上額外1000點的 Firecrawl 免費用量 Credits (看筆記) 📺 想要更進階的教學? 這份筆記教的是基礎的四個場景。 如果你想學: - Firecrawl 全部 15 個 Workflow 的完整教學 - 怎麼控制 Credits 消耗的進階技巧 - 怎麼用 Firecrawl 做 B2B 開發和接案 可以加入付費社群,裏面有完整的進階教學。

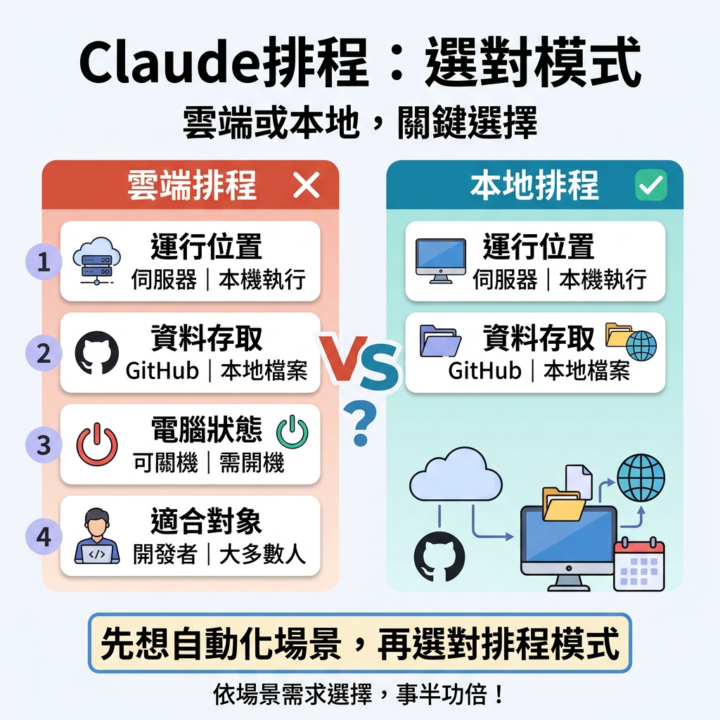

Claude Code 排程功能指南 — 你選對模式了嗎?

你有沒有想過,每天花在重複性工作上的時間,其實可以讓 AI 自動做? 「每天早上都要整理昨天的數據…」 「每週都要手動彙整週報…」 「競品又改價了,怎麼又是我最後才知道…」 Claude Code 最近推出了排程功能,可以讓 AI 按你設定的時間自動跑任務。但老實說,大部分人不知道這個功能其實有兩種完全不同的模式,選錯了等於白設。 今天完整講清楚:排程能做什麼、兩種模式差在哪、大部分人該選哪個 👇 --- 1️⃣ 排程功能能做什麼? 簡單說,就是你告訴 AI「每天幾點做什麼」,它就自動執行,不用你盯著。 🔍 每天早上自動上網搜集行業新聞,整理成一頁摘要 📊 定時抓取競爭對手網站的價格和產品變動 📋 每週自動把散落的數據整合成一份週報 🔔 監控你的網站有沒有掛掉,掛了直接通知你 頻率可以選:每小時、每天、工作日、每週,想自訂時間也行。 跟 ChatGPT Tasks 最大的差別:ChatGPT 的排程本質上是鬧鐘,到點提醒你去做事,你還是得自己動手。Claude 是真的幫你把事情做完,做完你直接去看結果就好。 --- 2️⃣ 兩種模式 — 這是大部分人搞混的地方 ☁️ 雲端排程 跑在 Anthropic 的伺服器上,你的電腦關機它照跑。聽起來很完美對吧? 但它有一個關鍵限制:只能操作放在 GitHub 上的程式碼專案。你電腦上的檔案,它完全讀不到。每次執行都是重新下載一份你的程式碼來跑,跑完就結束。 最短間隔:1 小時。 💻 本地排程 跑在你自己的電腦上,電腦要開著才會跑。 但它能讀你電腦上所有的檔案,也能上網操作。剛才說的那些場景 — 搜集新聞、抓競品、整合週報 — 全部都要用這個模式。 最短間隔:1 分鐘。 ❌ 常見的坑:看到「關機也能跑」就直接設雲端排程,結果你要自動化的東西全在電腦上,什麼都沒跑到。 ✅ 正確做法:先搞清楚你要自動化的東西在哪裡。不是寫程式的人,基本上都是用本地排程。 --- 3️⃣ 怎麼設定? 📌 本地排程 打開 Claude Code Desktop app → 找到 Schedule → 點 New local task → 寫清楚你要它做什麼 → 選頻率 → 搞定。 比如你想每天早上 9 點整理行業新聞,直接寫:「每天早上 9 點搜集 AI 行業最新新聞,整理成 5 條重點摘要,存到我的工作資料夾」。 📌 雲端排程 去 claude.ai/code/scheduled 設定,連接你的 GitHub repo,寫 prompt,選頻率。 安全方面,Claude 預設只會在 claude/ 開頭的分支上操作,不會動到你的主要程式碼。 --- 🎯 結論:從「功能驅動」升級為「場景驅動」 功能驅動思維:「排程好酷,我要用!」→ 直接設雲端 → 什麼都沒跑到 場景驅動思維:「我每天花 30 分鐘整理新聞,能自動化嗎?」→ 選對本地排程 → 真的省時間 工具是為場景服務的,不是反過來。先想清楚你每天重複做的事,再讓 AI 接手。 Pro $20/月就能用排程功能,不用額外付錢 💡 你每天花最多時間在哪件重複性工作上?留言分享,我幫你想想怎麼用排程自動化 👇

🚀 你的 Agent Skill 寫了好幾天還在調?讓 Skill 自己優化自己!

每次寫完一個 Skill,是不是都經歷這個循環? 寫好 SKILL.md → 跑一次 → 看輸出 → 覺得不太對 → 改指令 → 再跑 → 還是不太對 → 再改… 整個過程全靠你的「感覺」判斷。改了 10 版,不確定第 10 版是不是真的比第 1 版好。一個 Skill 調到穩定,花幾天很正常。 但如果有一套方法能讓 AI 自己調自己的 Skill 呢?今天分享 AutoResearch 的核心邏輯、Binary Eval 這個關鍵技術、以及怎麼套用到你自己的 Skill 上 👇 1️⃣ AutoResearch 的核心邏輯 AutoResearch 是用來自動優化 AI 的框架,原本拿來優化 AI 模型。 核心邏輯很簡單: 定義一個指標 → AI 自動跑多種變體 → 評分 → 保留更好的版本 → 淘汰差的 → 循環 這跟我們調 Skill 是一模一樣的道理。差別只在一點:AutoResearch 把「你靠感覺調」變成了「AI 用數據調」。 700 次自動實驗跑完,找到 20 個有效的優化方向,整體提升 11%。聽起來不多,但重點是:這全部是 AI 自己跑的,不需要人盯。 2️⃣ Binary Eval:讓 AI 穩定評分的關鍵 這裡有一個大部分人不知道的坑。 你可能想:「讓 AI 打分不就好了?」 問題是,用 1-7 分讓 AI 評分,同一個輸出它這次給 5 分,下次給 3 分,結果根本不穩定。AI 打分的變異性太大,你根本無法判斷 A 版本是不是真的比 B 版本好。 ❌ 錯誤做法:讓 AI 用 1-7 分評分 → 每次結果不同,優化方向亂跑 ✅ 正確做法:Binary Eval — 把所有品質標準拆成 yes/no 問題 「有沒有個人化開場?」→ yes 或 no 「CTA 是否只有一個?」→ yes 或 no 「subject line 少於 10 個字?」→ yes 或 no yes/no 的答案每次都一樣,AI 就能穩定判斷哪個版本更好。 這是整個系統能跑起來的關鍵。沒有穩定的評分,自動優化就是空談。 3️⃣ 實際例子:Cold Email Skill 假設你有一個寫 Cold Email 的 Skill。跑出來的信件,有些回覆率高,有些石沉大海。 以前怎麼調? 靠感覺:「好像 subject line 太長了」「CTA 不夠明確」 改完再跑,不確定是不是真的變好了 套用 AutoResearch + Binary Eval 的邏輯: 📊 把 reply rate 設成核心指標 📋 品質標準拆成 10-15 個 yes/no 問題 🔄 AI 自動跑幾十種變體 📈 每輪保留通過率更高的版本 行業平均 cold email reply rate 只有 3.43%,但 top performers 超過 10%。差距就在 Skill 指令的細節裡 — 而這些細節,用 Binary Eval 可以一個一個揪出來。 同樣邏輯可以套用到任何 Skill: 🔸 內容生成 Skill → 指標 = 品質通過率 🔸 SEO 文章 Skill → 指標 = 排名或流量 🔸 圖片生成 Skill → 指標 = 視覺品質通過率 🎯 結論:從「手動調 Skill」升級為「讓 Skill 自己進化」 舊思維:寫好 Skill → 靠感覺微調 → 花幾天找到「還行」的版本 新思維:定義指標 → 拆成 yes/no → 讓 AI 自動跑實驗 → 幾小時內找到最優版本 重點不在你寫得多好,在於你怎麼定義「好」。定義清楚了,AI 會自己找到怎麼做到好 💡 你有什麼 Skill 想用這個方法來優化?歡迎留言分享你的想法 👇

1-10 of 20

🔥

@netvcd-chien-5181

🎯 生成式AI應用顧問|AI工作流程自動化專家

🚀 專注用 AI 解決實際問題,提升效率、創造價值

👇 歡迎加入:

Skool|

🔗 https://www.skool.com/ai-playground

🔗 https://www.skool.com/ai-x-pro-1656

Online now

Joined Jan 12, 2026

Taiwan