Write something

📣 AI News: OpenAI zamyka Sora i skręca w stronę AI do pracy

OpenAI wyłączy Sora 26 kwietnia, a z firmy odchodzą ludzie prowadzący ten projekt, więc to już nie wygląda jak chwilowa korekta. To wygląda jak wyraźny skręt w stronę kodowania i narzędzi do codziennej pracy, bo tam dziś idzie największy nacisk. Jeśli uczysz się AI pod firmę albo własny proces pracy, to właśnie tam warto dziś patrzeć. https://www.theverge.com/ai-artificial-intelligence/914463/openai-sora-bill-peebles-kevin-weil-leaving-departing

1

0

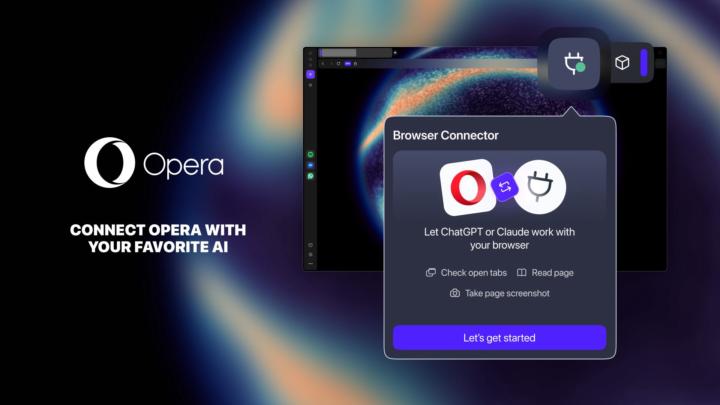

📣 AI News: Opera wpuszcza ChatGPT i Claude do przeglądarki

Opera wypuściła Browser Connector i to jest ciekawy kierunek: Claude albo ChatGPT mogą zobaczyć to, co masz otwarte w przeglądarce, zamiast kazać Ci wszystko kopiować ręcznie. W praktyce może to przyspieszyć porównywanie ofert, czytanie długich stron i ogarnianie kilku kart naraz, bo AI widzi stronę, czyta otwarte karty i robi zrzuty ekranu. Na razie to darmowa funkcja testowa w Opera One i Opera GX, ale dobrze pokazuje, że AI przestaje być tylko czatem obok pracy i zaczyna działać tam, gdzie ta praca już się dzieje. https://blogs.opera.com/news/2026/04/opera-new-browser-connector-brings-claude-and-chatgpt-into-the-browser/

1

0

📣 AI News: Claude zrobi z pomysłu prezentację albo makietę

Claude dostał nowy tryb Design. W praktyce wpisujesz pomysł albo wrzucasz plik, a on składa z tego prezentację, makietę albo materiał do pokazania klientowi. Potem możesz to wyeksportować dalej do Canvy, PDF albo PowerPointa, więc nie kończy się na samej zabawie w czacie. Dla osób, które robią oferty, slajdy albo szybkie szkice stron, to może być realna oszczędność czasu. https://www.anthropic.com/news/claude-design-anthropic-labs

1

0

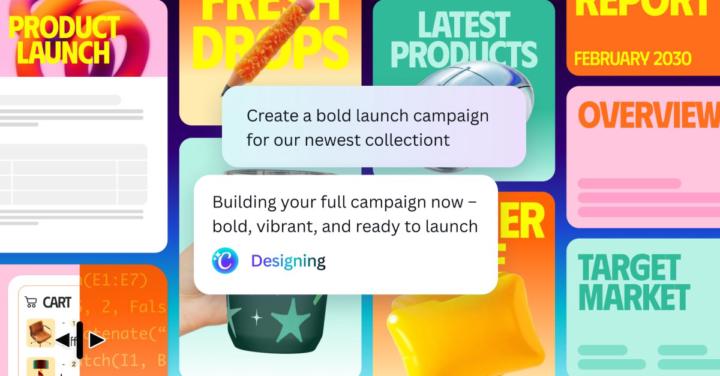

📣 AI News: Canva chce zamienić opis w gotowy projekt

Jeśli robisz w Canvie oferty, prezentacje albo posty, to ten kierunek jest ciekawy: opisujesz efekt, a narzędzie składa projekt i pozwala poprawiać konkretne elementy zwykłym tekstem. Dla małej firmy albo freelancera to może oznaczać mniej ręcznego klikania i szybsze dojście od briefu do gotowej wersji. Na razie to wersja testowa, ale dobrze pokazuje, w którą stronę idą takie narzędzia. Bardziej widzisz tu wartość w szybszym starcie projektu czy w poprawkach tekstem? https://www.theverge.com/tech/913068/canva-ai-2-update-prompt-based-editing-availability

1

0

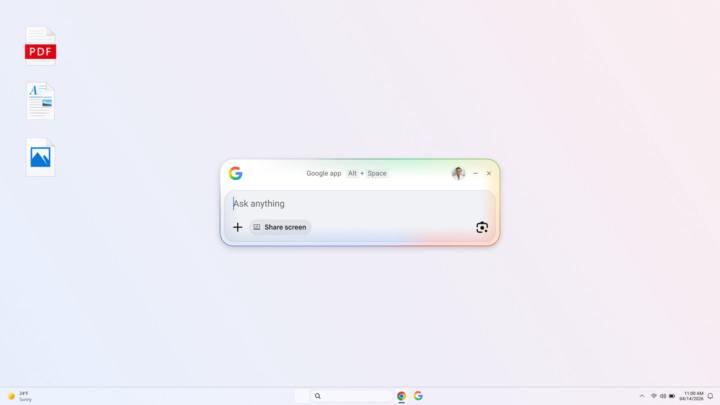

📣 AI News: Google dodaje AI do skrótu Alt + Spacja w Windowsie

Google wypuściło na Windowsa aplikację, która pod Alt + Spacja łączy wyszukiwarkę, pliki z komputera, aplikacje i Dysk Google w jednym miejscu. Możesz też pokazać jej okno albo cały ekran i dopytać o to, co właśnie masz przed sobą, więc mniej czasu znika na skakanie między kartami. Na razie działa globalnie po angielsku. Przydałby Ci się taki skrót w codziennej pracy? https://blog.google/products-and-platforms/products/search/google-apps-windows-english/

1

0

1-30 of 183

skool.com/startujai

Pokazujemy jak zrozumieć i praktycznie wykorzystać sztuczną inteligencję w życiu, pracy i biznesie.

Powered by