Activity

Mon

Wed

Fri

Sun

Apr

May

Jun

Jul

Aug

Sep

Oct

Nov

Dec

Jan

Feb

Mar

What is this?

Less

More

Memberships

Pablo Martínez García

16.2k members • Free

Comunidad Fundamentos IA

11.7k members • Free

2 contributions to Comunidad Fundamentos IA

Introducción

Soy Jorge Daniel Melilli. Soy venezolano y vivo en Alemania. Soy administrador de empresas, pero acá me dedico a instalaciónes de fibra óptica. Quiero aprender IA para poder aplicar la a mi vida y crear un negocio que me permita monetizar

0 likes • 13d

Hola. Mil gracias de antemano. Uso geminis frecuentemente. Y e estado investigando cómo sacarle mayor provecho a la IA. Se de manera muy básica todo lo que se puede lograr, (la creación de agentes, las automatizaciones, la creación de chat bots.) Los diferentes tipos de IA (texto, imágenes, videos) la creación de Buenos promst. Pero para aplicarlos a problemas reales no se exactamente como se conectan entre si. Y una vez que lograra crear una solución no se cómo puedo comercializarla. Es decir no estoy desde cero por completo pero tengo muchas dudas y vacíos

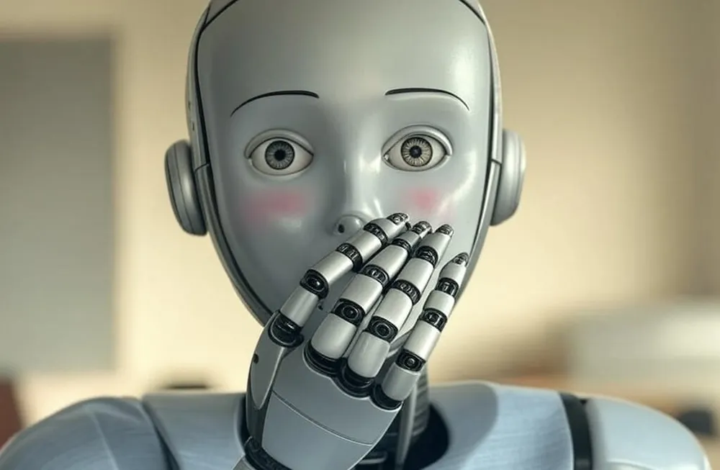

La trampa de las "Alucinaciones": ¿Cómo saber cuándo la IA te está mintiendo?

Si usas IA con regularidad, eventualmente te pasará: le haces una pregunta técnica, te responde con una seguridad absoluta, pero la información es 100% falsa. En el mundo de la IA, a esto le llamamos "alucinación". Para quienes estamos empezando, es vital entender por qué ocurre esto y, sobre todo, cómo protegerse de estos errores antes de dar por buena cualquier respuesta. ¿Por qué la IA inventa cosas? Es un error común pensar que los modelos de lenguaje (LLMs) son buscadores de hechos o bases de datos. No lo son. Un LLM es un modelo probabilístico. Su trabajo no es "saber la verdad", sino predecir qué palabra debería seguir a la anterior basándose en patrones estadísticos. Cuando la IA no encuentra una respuesta clara en sus datos de entrenamiento, a veces rellena los espacios vacíos con información que suena coherente, pero que es técnicamente incorrecta. Protocolo de seguridad para tus prompts Para no caer en la trampa, integra estos tres pasos en tu flujo de trabajo: 1. La Regla de la Fuente Primaria: Si la IA te da un dato, una ley, o una cifra, nunca la tomes como final. Usa Google o bases de datos oficiales para verificar la fuente original. Si la IA no puede citar una fuente verificable, desconfía. 2. El Reto de la Autocrítica: Antes de usar la respuesta, añade este comando: "Revisa tu respuesta anterior. ¿Existe alguna posibilidad de que estés equivocado o que falte contexto? Enumera las posibles fuentes de error." 3. No le des la razón: A veces, si le preguntas "¿Es X correcto?", la IA intentará complacerte y te dirá que sí, aunque sea falso. Pregunta de forma neutra: "¿Qué información existe sobre X?" en lugar de induciéndola a confirmar tu duda. Análisis Crítico: El "Sesgo de Automatización" El mayor riesgo no es la tecnología, es tu confianza. El sesgo de automatización es la tendencia humana a confiar en una máquina porque "suena profesional" o "es tecnológica". - El peligro: En ámbitos legales, médicos o de programación, una alucinación puede tener consecuencias reales. - La solución: Trata a la IA como a un pasante muy entusiasta pero que a veces no ha dormido y confunde datos. Nunca le delegues la responsabilidad final sin supervisión humana.

Poll

17 members have voted

1-2 of 2

Active 1h ago

Joined Mar 4, 2026

Powered by