Activity

Mon

Wed

Fri

Sun

May

Jun

Jul

Aug

Sep

Oct

Nov

Dec

Jan

Feb

Mar

Apr

What is this?

Less

More

Owned by Nalia

Será como tener al equipo de MrBeast… pero trabajando para ti las 24 horas. Automatiza la creación de videos para YouTube y RRSS con IA, sin programar

Memberships

IA BUILDERS CLUB PRO

33 members • $10,000/month

Team Aria Cruz

156 members • $4/month

33 contributions to Master en Avatares con IA 🤖

Estrategia Product Placement: Workflow de 3 Pasos

La mayoría falla al integrar productos porque la IA tiende a rediseñarlos para que encajen en la escena. Aquí os dejo el sistema para mantener la fidelidad total de la marca, usando como ejemplo mi marca personal Master en Avatares. Los dos enfoques posibles 1. Escena primero, producto después: Generas el entorno y luego intentas meter el producto. Problema: La IA suele distorsionar el logo o las proporciones para que "peguen" con la luz 2. Producto primero, escena después: Generas el objeto perfecto y construyes el mundo a su alrededor. Es el método que os recomiendo para trabajos profesionales. Cómo controlar las proporciones La IA no sabe cuánto mide un frasco. Para evitar que un perfume parezca del tamaño de un jarrón, especifica siempre la relación espacial: - Botella de unos 15 cm de alto. - El producto ocupa 1/4 del ancho del encuadre. - Añade siempre: "Preserve exact bottle shape and proportions from reference image". El Workflow de los 3 Prompts Paso 1: El producto en estudio (Solo) Generamos la base perfecta. "Professional luxury product photography of a men's perfume bottle. Sculptural organic shape, thick amber-tinted glass. Brand name Master en Avatares engraved in thin elegant serif typography on the front. Studio lighting, white marble surface. Ultra-realistic, 4K." Paso 2: La escena alrededor del producto Subes la imagen anterior como referencia. "The exact perfume bottle from the reference image with Master en Avatares branding. Minimalist luxury apartment, large windows, warm afternoon sunlight. Marble table surface. Do not modify the bottle in any way. Ultra-realistic, 4K." Paso 3: Integración del Avatar Subes la escena del paso 2 como referencia. "Same scene exactly. Add a young adult man, 30s, calm confident expression, seated beside the table. Bottle with Master en Avatares remains sharp in the foreground. Same lighting and skin texture with visible pores. Ultra-realistic, 4K." ¿Se puede cobrar por esto? Aunque este trabajo lo he hecho como ejemplo para la comunidad y no ha sido un encargo pagado, es un servicio con una demanda brutal. Si dominas este flujo, estos son los precios de mercado para clientes reales:

Flujo de Trabajo : Ingeniería Inversa de Vídeos Virales con IA

Quiero compartir un sistema que utilizo para deconstruir contenido. Cuando identifico un Reel o TikTok con un rendimiento excepcional, en lugar de intentar adivinar cómo se hizo, aplico ingeniería inversa. Paso 1: Análisis y Extracción Descarga el vídeo objetivo y súbelo a Gemini. Su capacidad para procesar los datos visuales y el audio de forma simultánea es muy alta. Identificará el guion, separará las escenas, detectará los ángulos de cámara y analizará el ritmo general. Paso 2: El Prompt de Deconstrucción Esta es la estructura exacta que utilizo para obtener el esqueleto del vídeo. Puedes copiarla directamente: Rol: Eres un especialista en análisis de vídeo e ingeniería inversa con IA. Tu objetivo es deconstruir el vídeo adjunto en un desglose técnico detallado para entender su estructura y producción. Tarea: Realiza un análisis plano a plano. Debes extraer y organizar la siguiente información: - Marcas de tiempo: Segundo de inicio y fin para cada cambio de plano o ángulo. - Cinematografía: Tipo de plano (ej. primer plano, plano medio) y movimiento de cámara (estática, seguimiento, zoom). - Sujeto y Entorno: Descripción exhaustiva de la persona (apariencia, vestuario, actitud) y los elementos del fondo (iluminación, decoración). - Objetos: Lista de elementos clave visibles (modelos de teléfono, mobiliario, etc.). - Guion: Transcripción exacta del diálogo sincronizada con las marcas de tiempo. - Análisis IA (Opcional): Si el vídeo parece generado por IA, señala indicadores técnicos como texturas de piel, precisión de la sincronización labial o errores de iluminación. Formato de salida: Presenta el desglose en una tabla Markdown limpia, seguida de un breve resumen del "Gancho Visual" y la "Configuración Técnica". Tono: Analítico, preciso y profesional. Paso 3: Integración y Reconstrucción Una vez tienes el esqueleto, puedes escalar el proceso. Dentro de esa misma conversación, educa al modelo sobre tus propias herramientas. Proporciónale contexto sobre:

1 like • 19h

Muy bueno. Lo probaré seguramente hoy mismo. Eso sí, últimamente me genera bastante duda eso que comentas en el “paso 3”. Todos hablan de educar al modelo pero ya no sé si realmente requiere algún proceso determinado o se ha convertido en simple forma de hablar. Como educarlo para cada tarea que hagamos? Lo hacemos en proyecto independiente incluyendo varios chats en el mismo? Le debemos incluir archivos diversos en el propio proyecto? No sé! Ya le pierdo un poco en ese detalle

ACTUALIZACIÓN IA: Ya está aquí la API de Seedance 2.0 (Pero cuidado)

Acaba de salir la tan esperada API de Seedance 2.0 en plataformas de terceros. ¿Dónde se puede acceder ahora mismo? Higgsfield (Ojo: solo para planes Team o Business de momento).OpenArt, Freepik... CapCut (Lanzamiento progresivo, aún no está en todas las cuentas). Mi recomendación: Hay una barbaridad de marketing agresivo ahí fuera prometiendo acceso exclusivo, plazas limitadas y descuentos locos. La gran mayoría es ruido para generar FOMO. La realidad de cualquier lanzamiento tocho como este es que todo el mundo está entrando de golpe. ¿El resultado? Los tiempos de generación van a ser una pesadilla. Personalmente, os recomiendo esperar a que el acceso sea estable en todas partes antes de pagar un extra para ser los primeros. Dejad que los servidores respiren. Por qué esto lo va a cambiar todo (cuando funcione bien): Seedance 2.0 no es solo otro modelo de vídeo, es lo más parecido a tener un flujo de producción completo en una sola herramienta. Para nuestra estrategia de avatares y monetización esto es lo que más nos interesa: Audio y vídeo nativo en una sola pasada: Se acabó el tener que sincronizar la voz a posteriori. Storytelling multi-escena: Varios planos seguidos desde un único prompt. Hasta 12 inputs de referencia a la vez: Puedes meter imágenes, vídeo y audio para clavar tu contenido. 15 segundos por clip: Con una consistencia de personaje (nuestro avatar) bloqueada y perfecta. Lip-sync a nivel de fonema: Sincronización labial brutal en más de 8 idiomas. En resumen: Para darle duro con anuncios UGC y vídeos multi-escena , esto puede ser una herramienta clave. Os iré avisando por aquí cuando sea el momento ideal para testearlo.

Nano Banana 2 vs Higgsfield Soul 2.0 🤖

¡Familia! Ha salido nueva herramienta para generación de imágenes en Higgsfield se trata de Soul 2.0. La he puesto frente a frente con Nano Banana 2. Para que la comparativa sea 100% justa, he utilizado exactamente el mismo prompt en ambos generadores. El objetivo era buscar ese nivel de detalle hiperrealista y natural que necesitamos para que nuestros clones digitales conecten de verdad con la audiencia. Tenéis las dos imágenes adjuntas. Fijaos muy bien en los detalles: la textura de la piel, la iluminación, las arrugas de la ropa y, sobre todo, la mirada. A ver si adivinais con cual está hecha cada una. Aquí os dejo el prompt exacto que he utilizado, por si queréis copiarlo, trastear con él y aplicarlo a vuestros propios flujos de trabajo: Ultra-realistic portrait of a young muscular man sitting on a simple metal chair against a plain light grey wall. The man is seated facing the camera, slightly leaning back, with a relaxed but confident posture. His arms are crossed over his chest, emphasizing his muscular build. Body & Appearance: athletic, well-defined physique (visible biceps, shoulders, forearms), natural muscle definition (not exaggerated bodybuilding), lightly tanned skin with realistic texture, pores, subtle imperfections. Face & Hair: short dark brown hair, slightly messy, natural texture, short beard / light stubble, strong jawline, masculine features, calm, confident expression with a slight smirk, looking directly at the camera. Clothing: fitted black tank top, loose, slightly oversized blue jeans, worn low on the waist, jeans have a slightly rugged, imperfect look (small stains / worn details). Accessories: thin chain necklace, subtle tattoo on the forearm (minimal, fine-line style). Environment: plain, minimalist interior, light grey wall background with no decoration, simple metal chair visible behind him. Lighting: soft, natural indoor lighting, slightly moody tone (not overly bright), gentle shadows on face and body for depth, neutral to slightly cool color grading.

2 likes • 19d

La de la izquierda es un 9.5/10 La de la derecha un 6/10 La izquierda no veo fallo salvo las pestañas que apenas se aprecian, los puñones del pectoral se ven algo raros y el tatuaje. La de la derecha las texturas (piel y tela de la ropa sobre todo el pantalón por la zona inginal) tiene patrón tipo papel rugoso y no es 100% aleatorio. Los pelos menos definido etc… Sin duda alguna Nanobanana 2 es la de la izquierda 🤪 (la que está más clara)

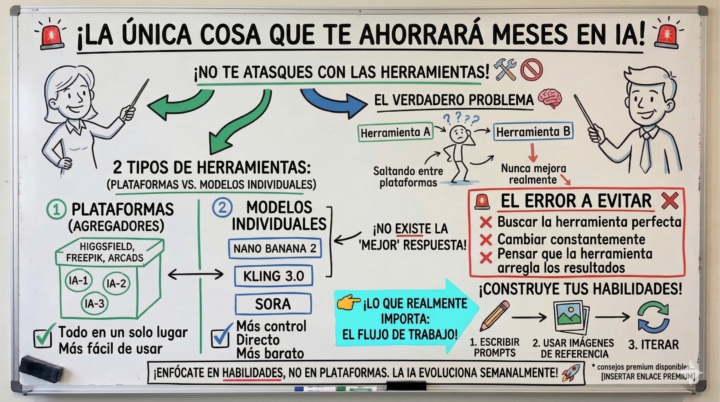

El error que te hará perder MESES con la IA (Muy Importante)

Si estás empezando a crear avatares, hay algo que la gran mayoría entiende al revés: Las herramientas NO importan tanto como crees. El Problema Real: La mayoría de principiantes se atascan preguntando: ¿Cuál es la mejor IA? ¿Uso Midjourney, Nano Banana 2 o HeyGen?. Saltan de una herramienta a otra cada dos días buscando la solución mágica... y sus resultados nunca mejoran (siguen pareciendo de plástico). Cómo funciona esto realmente (Solo hay 2 tipos de herramientas): Plataformas (Agregadores): Regrupan varias IAs en un solo sitio (Ej: Freepik, Higsfield). Ventaja: Fáciles de usar, todo en un mismo lugar, menos configuración. Modelos Directos: Vas a la fuente original (Ej: Nano Banana 2 para imagen, Veo para animar vídeo, Kling). Ventaja: Tienes el control absoluto, usos más avanzados y suelen ser más baratos. Entonces, ¿Cuál uso? No existe la herramienta perfecta. El error fatal es pensar que cambiar de IA arreglará tus avatares. Lo que de verdad importa y marca la diferencia es TU WORKFLOW. Si dominas las bases: Cómo escribir buenos prompts, cómo usar imágenes de referencia (tu ancla). cómo iterar hasta conseguir realismo. Podrás usar CUALQUIER herramienta que salga al mercado. La IA cambia cada semana, tus habilidades no. Enfócate en la habilidad, no en la plataforma. 🦾🚀

2 likes • 19d

@Lina Santos Los prompts debe hacerlos la IA. Esos prompts que son enormes nadie los hace desde cero manualmente. Sí se pueden retocar y afinar para conseguir mejores resultados a base de ensayo y error. Las peleas con la IA son épicas en muchas ocasiones. Toca insistir y trabajarlo hasta conseguir el resultado buscado. Ánimo, no estás sola 😅

1-10 of 33

@bull-rex-7411

The GoobTuber.

Me mueve la IA y la idea de crear contenido que realmente merezca la atención de la gente. Busco la calidad en mis creaciones.

Active 7h ago

Joined Jan 14, 2026